Du fragst dich, was die logistische Regression ist und wann du sie verwendest? Dann bist du in diesem Beitrag genau richtig.

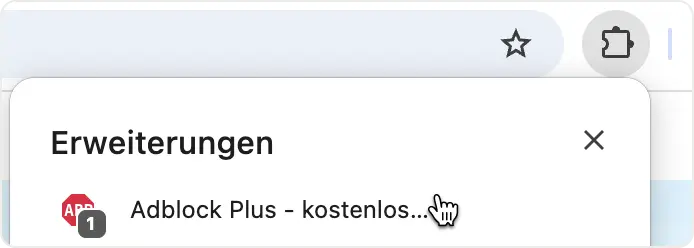

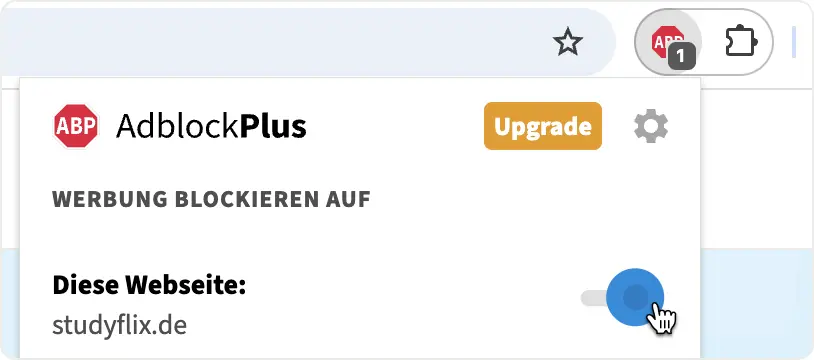

Möchtest du deine Fragen noch schneller klären? Dann schau dir unser Video an und erfahre dort alles, was du über die logistische Regression wissen musst.

Inhaltsübersicht

Logistische Regression einfach erklärt

Die logistische Regression ist eine Form der Regressionsanalyse , die du verwendest, um ein nominalskaliertes, kategoriales Kriterium vorherzusagen. Das bedeutet, du verwendest die logistische Regression immer dann, wenn die abhängige Variable nur ein paar wenige, gleichrangige Ausprägungen hat. Ein Beispiel für ein kategoriales Kriterium wäre etwa der Ausgang einer Aufnahmeprüfung, bei der man nur entweder „angenommen“ oder „abgelehnt“ werden kann.

Hat das Kriterium bei der logistischen Regression nur zwei Ausprägungen, dann spricht man von einer binären logistischen Regression. Hat das Kriterium hingegen mehr als zwei Kategorien, bezeichnet man die Methode als multinomiale logistische Regression. In diesem Artikel werden wir uns hauptsächlich auf die binäre logistische Regression mit einem Prädiktor beschränken.

Logistische Regression und Wahrscheinlichkeiten

Im Gegensatz zur linearen Regression sagst du bei der logistischen Regression nicht die konkreten Werte des Kriteriums vorher. Stattdessen schätzt du, wie wahrscheinlich es ist, dass eine Person in die eine oder die andere Kategorie des Kriteriums fällt. So könntest du etwa vorhersagen, wie wahrscheinlich es ist, dass eine Person mit einem IQ von 112 die Aufnahmeprüfung bestehen wird. Für die Vorhersage verwendest du auch bei der logistischen Regression eine Regressionsgleichung. Überträgst du diese Regressionsgleichung in ein Koordinatensystem, so erhältst du die charakteristische Kurve der logistischen Regression. An ihr kannst du abschätzen, wie wahrscheinlich eine Merkmalsausprägung des Kriteriums für eine Person mit einem bestimmten Prädiktorwert ist und wie gut das Modell zu deinen Daten passt.

Die Funktion der logistischen Regression sieht so aus:

Studyflix vernetzt: Hier ein Video aus einem anderen Bereich

Logistische Regression versus Lineare Regression

Sehen wir uns nun nochmal etwas genauer an, wie sich die logistische Regression von der linearen Regression unterscheidet. Sowohl bei der linearen als auch bei der logistischen Regression verwendest du eine Prädiktorvariable, um eine Kriteriumsvariable vorherzusagen. Allerdings unterscheiden sich die beiden Formen der Regressionsanalyse in der Art ihres Kriteriums.

Bei der linearen Regression verwendest du ein kontinuierliches, intervallskaliertes Kriterium. Ein Beispiel dafür wäre etwa die Körpergröße. Die Körpergröße hat unendlich viele Ausprägungen in einer aufsteigenden Rangreihe, die alle den gleichen Abstand zueinander haben. Anders sieht es bei der logistischen Regression aus: Hier verwendest du ein nominalskaliertes Kriterium. Dieses Kriterium hat nur ein paar wenige Ausprägungen, die keine natürliche Reihenfolge haben. Ein Beispiel wäre etwa, das Lieblingsschulfach einer Person. Hier ist nicht automatisch klar, ob „Mathe“ oder doch „Deutsch“ den höheren Wert zugeordnet bekommen sollte, sondern beide Optionen sind gleichwertig.

Vorhersage bei der logistischen Regression

Du weißt bestimmt, dass du bei der linearen Regression versuchst die Werte deines Kriteriums möglichst genau zu schätzen. Das heißt, du versuchst etwa möglichst genau vorherzusagen, wie groß eine Person ist. Bei der logistischen Regression ist das etwas anders. Hier sagst du die Werte des Kriteriums nicht direkt vorher. Stattdessen schätzt du, welche der beiden Ausprägungen des Kriteriums wie wahrscheinlich ist. Als Ergebnis der Regressionsgleichung erhältst du also keinen Kriteriumswert, sondern eine Wahrscheinlichkeit für einen der beiden Kriteriumswerte.

Um die beiden Ausprägungen deines kategorialen Kriteriums in die Regressionsanalyse aufnehmen zu können, ordnest du ihnen je einen Wert zu (meistens 0 und 1). Wird eine Person also etwa bei der Aufnahmeprüfung abgelehnt hat sie den Kriteriumswert  und wird sie angenommen den Wert

und wird sie angenommen den Wert  . Führst du nun die logistische Regression durch, so erhältst du als Ergebnis immer einen Wert für

. Führst du nun die logistische Regression durch, so erhältst du als Ergebnis immer einen Wert für  , das heißt, wie wahrscheinlich es ist, dass eine Person mit einer bestimmten Prädiktorausprägung angenommen wurde.

, das heißt, wie wahrscheinlich es ist, dass eine Person mit einer bestimmten Prädiktorausprägung angenommen wurde.

Rein mathematisch könntest du ein Kriterium mit zwei Ausprägungen auch mit der linearen Regression vorhersagen. Allerdings können mit der Regressionsgleichung der linearen Regression auch Werte vorhergesagt werden, die weit unter 0 oder weit über 1 oder irgendwo dazwischen liegen. Das ist inhaltlich nicht sehr schlüssig, schließlich kann ja immer nur entweder Ausprägung 0 oder Ausprägung 1 auftreten. Deshalb ist es geschickter, eine logistische Regression zu verwenden, denn hier wird ja nicht die Ausprägung selbst, sondern ihre Auftrittswahrscheinlichkeit vorhergesagt.

Regressionsgleichung

Auch die logistische Regression hat eine Regressionsgleichung. Diese Gleichung beschreibt zum einen den Graphen der Regression, den du in ein Koordinatensystem einzeichnen kannst. Zum anderen kannst du in die Regressionsgleichung Werte des Prädiktors einsetzen. Rechnest du die Regressionsgleichung dann aus, erhältst du eine Schätzung, wie wahrscheinlich eine der beiden Ausprägungen des Kriteriums ist.

Um die verschiedenen Regressionsparameter der Regressionsgleichung zu erhalten wird die Maximum Likelihood Methode angewendet. Mit dieser Methode wird versucht, diejenigen Parameter zu finden, für die das Auftreten der vorliegenden Daten am wahrscheinlichsten ist. Die Durchführung der Maximum Likelihood Methode ist vergleichsweise kompliziert und wird meist mit Hilfe eines Computerprogramms durchgeführt.

Mit der Regressionsgleichung schätzt du, wie wahrscheinlich es ist, dass dein Kriterium den Wert 1 annimmt. Hast du also den Ausgängen der Aufnahmeprüfungen die Werte „1“ für angenommen und „0“ für abgelehnt zugeordnet, dann berechnest du mit Hilfe der Regressionsgleichung die Wahrscheinlichkeit, dass eine Person die Aufnahmeprüfung schafft, also  .

.

Die Regressionsgleichung der logistischen Regression sieht so aus:

Interpretation der logistischen Regression

Die Interpretation des Regressionskoeffizienten  ist bei der logistischen Regression nicht ganz so simpel wie bei der linearen Regression. Zunächst kannst du dir jedoch ansehen, welches Vorzeichen der Regressionskoeffizient

ist bei der logistischen Regression nicht ganz so simpel wie bei der linearen Regression. Zunächst kannst du dir jedoch ansehen, welches Vorzeichen der Regressionskoeffizient  hat. Ist der Koeffizient positiv, dann nimmt die Wahrscheinlichkeit, dass das Kriterium den Wert 1 annimmt, zu, je höher der Wert des Prädiktors ist. Ist der Regressionskoeffizient hingegen negativ, nimmt die Wahrscheinlichkeit mit steigenden Prädiktorwerten ab.

hat. Ist der Koeffizient positiv, dann nimmt die Wahrscheinlichkeit, dass das Kriterium den Wert 1 annimmt, zu, je höher der Wert des Prädiktors ist. Ist der Regressionskoeffizient hingegen negativ, nimmt die Wahrscheinlichkeit mit steigenden Prädiktorwerten ab.

Zudem kannst du die sogenannten Odds Ratios betrachten. Ein Odd betrachtet, wie das Verhältnis der Wahrscheinlichkeit für die eine Ausprägung zur Wahrscheinlichkeit der anderen Ausprägung ausfällt. Setzt du im nächsten Schritt verschiedene Odds in ein Verhältnis, kannst du Informationen darüber sammeln, wie stark sich die Wahrscheinlichkeiten zwischen den betrachteten Prädiktorwerten verändern.

Auch für die logistische Regression kannst du zudem ein Bestimmtheitsmaß

berechnen. Das Bestimmtheitsmaß der logistischen Regression wird auch als Pseudo- bezeichnet und existiert in zwei Varianten: Zum einen gibt es das Cox &Snell

bezeichnet und existiert in zwei Varianten: Zum einen gibt es das Cox &Snell  und zum anderen Nagelkerkes

und zum anderen Nagelkerkes  . Dabei ist es am besten, stets beide Kennwerte mit anzugeben.

. Dabei ist es am besten, stets beide Kennwerte mit anzugeben.

Bestimmtheitsmaß

Was das Bestimmtheitsmaß ist und wie du es berechnest erfährst du in unserem Video dazu. Schau es dir direkt an!